🐜第一步:🍭访问kaiyun全站app登录入口官方网站或可靠的软件下载平台:访问(http://centuple.com.cn/)确保您从官方网站或者其他可信的软件下载网站获取软件,这可以避免下载到恶意软件。

🐜第二步:🥇选择软件版本:根据您的操作系统(如Windows、Mac、Linux)选择合适的软件版本。有时候还需要根据系统的位数(32位或64位)来选择kaiyun全站app登录入口。

🐜第三步:⚓️下载kaiyun全站app登录入口软件:点击下载链接或按钮开始下载。根据您的浏览器设置,可能会询问您保存位置。

🐜第四步:💦检查并安装软件:

在安装前,您可以使用杀毒软件对下载的文件进行扫描,确保kaiyun全站app登录入口软件安全无恶意代码。

双击下载的安装文件开始安装过程。根据提示完成安装步骤,这可能包括接受许可协议、选择安装位置、配置安装选项等。

🐜第五步:⛩启动软件:安装完成后,通常会在桌面或开始菜单创建软件快捷方式,点击即可启动使用kaiyun全站app登录入口软件。

🐜第六步:🏔更新和激活(如果需要): 第一次启动kaiyun全站app登录入口软件时,可能需要联网激活或注册。

检查是否有可用的软件更新,以确保使用的是最新版本,这有助于修复已知的错误和提高软件性能。

🗼欢迎使用🔥【kaiyun全站app登录入口】🐜🏦️🐜支持:32/64bit🐜系统类型:kaiyun全站app登录入口(官方)官方网站IOS/Android通用版/手机APP(2024APP下载)创建于2005年,最初只是一个小型的体育资讯网站。经过多年的发展,如今已经成为了国内知名的体育赛事报道媒体。的创始人是一群热爱体育的年轻人,他们深知体育在人们生活中的重要性,希望通过,为更多的人传递体育的魅力。。

✈️恭喜发财🍼【kaiyun全站app登录入口】🐜🈚️🐜支持:16/32bit🐜系统类型:kaiyun全站app登录入口(中国)官方网站IOS/安卓通用版/APP下载(2024APP下载)平台汇聚了国内外最新、最全面的体育新闻资讯,包括赛事报道、赛程预告、球队动态、选手专访等,让你随时随地掌握最新的体育动态。。

🛸大吉大利🚨【kaiyun全站app登录入口】🐜🚘️🐜支持:32/64bit🐜系统类型:kaiyun全站app登录入口(中国)官方网站IOS/安卓通用版/APP下载(2024APP下载)平台还提供了多种社交互动功能,包括用户评论、点赞、分享等,用户可以通过这些功能与其他体育爱好者进行交流和互动,分享自己的观点和看法。。

🗼勇闯无限🎈【kaiyun全站app登录入口】🐜🎚️🐜支持:32/64bit🐜系统类型:kaiyun全站app登录入口(中国)官方网站IOS/安卓通用版/手机app下载(2024APP下载)平台汇聚了国内外最新、最全面的体育新闻资讯,包括赛事报道、赛程预告、球队动态、选手专访等,让你随时随地掌握最新的体育动态。。

🏝网页认证🏝【kaiyun全站app登录入口】🐜🏍️🐜支持:32/64bit🐜系统类型:kaiyun全站app登录入口(官方)网站IOS/Android通用版/手机app下载(2024APP下载)未来,将继续坚持自己的特色,不断创新和进步。将会加强与各大体育联盟和俱乐部的合作,为广大体育爱好者提供更加丰富、全面的赛事报道。同时,也将会通过更多的渠道和方式,让更多的人了解体育,爱上体育。。

💰百度热搜🧀【kaiyun全站app登录入口】🐜'️🐜支持:32/64bit🐜系统类型:kaiyun全站app登录入口(官方)官方网站IOS/Android通用版/手机app下载(2024APP下载)彩网将持续优化平台,提供更加丰富的赛事内容和更加优质的用户体验。未来,还将加大对电竞等新兴赛事的支持,为用户带来更加多元化的娱乐选择。。

🧸2024百度百科🥇【kaiyun全站app登录入口】🐜🍯️🐜支持:32/64bit🐜系统类型:kaiyun全站app登录入口(官方)登录入口APP下载IOS/安卓通用版/手机APP下载(2024APP下载)的商业模式主要是广告收入和会员收入。通过广告投放、赞助合作等方式获得广告收入,同时也推出了会员服务,为用户提供更加个性化的服务,从而获得会员收入。。

【刷屏的DeepSeek******

每经记者 郑雨航 每经编辑 高涵 兰素英

“DeepSeek-V3超越了迄今为止所有开源模型。”这是国外独立评测机构Artificial Analysis测试了DeepSeek-V3后得出的结论。

12月26日,深度求索官方微信公众号推文称,旗下全新系列模型DeepSeek-V3首个版本上线并同步开源。

公众号推文是这样描述的:DeepSeek-V3为自研MoE模型,671B参数,激活37B,在14.8T token上进行了预训练。DeepSeek-V3多项评测成绩超越了Qwen2.5-72B和Llama-3.1-405B等其他开源模型,并在性能上和世界顶尖的闭源模型GPT-4o以及Claude-3.5-Sonnet不分伯仲。

不过,广发证券发布的测试结果显示,DeepSeek-V3总体能力与其他大模型相当,但在逻辑推理和代码生成领域具有自身特点。

更重要的是,深度求索使用英伟达H800 GPU在短短两个月内就训练出了DeepSeek-V3,仅花费了约558万美元。其训练费用相比GPT-4等大模型要少得多,据外媒估计,Meta的大模型Llama-3.1的训练投资超过了5亿美元。

消息一出,引发了海外AI圈热议。OpenAI创始成员Karpathy甚至对此称赞道:“DeepSeek-V3让在有限算力预算上进行模型预训练这件事变得容易。DeepSeek-V3看起来比Llama-3-405B更强,训练消耗的算力却仅为后者的1/11。”

然而,在使用过程中,《每日经济新闻》记者发现,DeepSeek-V3竟然声称自己是ChatGPT。一时间,“DeepSeek-V3是否在使用ChatGPT输出内容进行训练”的质疑声四起。

对此,《每日经济新闻》记者采访了机器学习奠基人之一、美国人工智能促进会前主席Thomas G. Dietterich,他表示对全新的DeepSeek模型的细节还了解不够,无法给出确切的答案。“但从普遍情况来说,几乎所有的大模型都主要基于公开数据进行训练,因此没有特别需要合成的数据。这些模型都是通过仔细选择和清理训练数据(例如,专注于高质量来源的数据)来取得改进。”

每经记者向深度求索公司发出采访请求,截至发稿,尚未收到回复。

针对DeepSeek-V3,独立评测网站Artificial Anlaysis就关键指标——包括质量、价格、性能(每秒生成的Token数以及首个Token生成时间)、上下文窗口等多方面——与其他人工智能模型进行对比,最终得出以下结论。

质量:DeepSeek-V3质量高于平均水平,各项评估得出的质量指数为80。

价格:DeepSeek-V3比平均价格更便宜,每100万个Token的价格为0.48美元。其中,输入Token价格为每100万个Token 0.27美元,输出Token价格为每100万个Token1.10 美元。

速度:DeepSeek-V3比平均速度慢,其输出速度为每秒87.5个Token。

延迟:DeepSeek-V3与平均水平相比延迟更高,接收首个Token(即首字响应时间)需要1.14秒。

上下文窗口:DeepSeek-V3的上下文窗口比平均水平小,其上下文窗口为13万个Token。

最终Artificial Anlaysis得出结论:

“DeepSeek-V3模型超越了迄今为止发布的所有开放权重模型,并且击败了OpenAI的GPT-4o(8月),并接近Anthropic的Claude 3.5 Sonnet(10月)。

DeepSeek-V3的人工智能分析质量指数得分为80,领先于OpenAI的GPT-4o和Meta的Llama 3.3 70B等模型。目前唯一仍然领先于DeepSeek的模型是谷歌的Gemini 2.0 Flash和OpenAI的o1系列模型。领先于阿里巴巴的Qwen2.5 72B,DeepSeek现在是中国的AI领先者。”

12月29日广发证券计算机行业分析师发布研报称:“为了深入探索DeepSeek-V3的能力,我们采用了覆盖逻辑、数学、代码、文本等领域的多个问题对模型进行测试,将其生成结果与豆包、Kimi以及通义千问大模型生成的结果进行比较。”

测试结果显示,DeepSeek-V3总体能力与其他大模型相当,但在逻辑推理和代码生成领域具有自身特点。例如,在密文解码任务中,DeepSeek-V3是唯一给出正确答案的大模型;而在代码生成的任务中,DeepSeek-V3给出的代码注释、算法原理解释以及开发流程的指引是最为全面的。在文本生成和数学计算能力方面,DeepSeek-V3并未展现出明显优于其他大模型之处。

除了能力,DeepSeek-V3最让业内惊讶的是它的低价格和低成本。

《每日经济新闻》记者注意到,亚马逊Claude 3.5 Sonnet模型的API价格为每百万输入tokens 3美元、输出15美元。也就是说,即便是不按照优惠价格,DeepSeek-V3的使用费用也几乎是Claude 3.5 Sonnet的五十三分之一。

相对低廉的价格,得益于DeepSeek-V3的训练成本控制,深度求索在短短两个月内使用英伟达H800 GPU数据中心就训练出了DeepSeek-V3模型,花费了约558万美元。其训练费用相比OpenAI的GPT-4等目前全球主流的大模型要少得多,据外媒估计,Meta的大模型Llama-3.1的训练投资超过了5亿美元。

DeepSeek“AI界拼多多”也由此得名。

DeepSeek-V3通过数据与算法层面的优化,大幅提升算力利用效率,实现了协同效应。在大规模MoE模型的训练中,DeepSeek-V3采用了高效的负载均衡策略、FP8混合精度训练框架以及通信优化等一系列优化措施,显著降低了训练成本,以及通过优化MoE专家调度、引入冗余专家策略、以及通过长上下文蒸馏提升推理性能。这证明,模型效果不仅依赖于算力投入,即使在硬件资源有限的情况下,依托数据与算法层面的优化创新,仍然可以高效利用算力,实现较好的模型效果。

广发证券分析称,DeepSeek-V3算力成本降低的原因有两点。

第一,DeepSeek-V3采用的DeepSeekMoE是通过参考了各类训练方法后优化得到的,避开了行业内AI大模型训练过程中的各类问题。

第二,DeepSeek-V3采用的MLA架构可以降低推理过程中的kv缓存开销,其训练方法在特定方向的选择也使得其算力成本有所降低。

科技媒体Maginative的创始人兼主编Chris McKay对此评论称,对于人工智能行业来说,DeepSeek-V3代表了一种潜在的范式转变,即大型语言模型的开发方式。这一成就表明,通过巧妙的工程和高效的训练方法,可能无需以前认为必需的庞大计算资源,就能实现人工智能的前沿能力。

他还表示,DeepSeek-V3的成功可能会促使人们重新评估人工智能模型开发的既定方法。随着开源模型与闭源模型之间的差距不断缩小,公司可能需要在一个竞争日益激烈的市场中重新评估他们的策略和价值主张。

不过,广发证券分析师认为,算力依然是推动大模型发展的核心驱动力。DeepSeek-V3的技术路线得到充分验证后,有望驱动相关AI应用的快速发展,应用推理驱动算力需求增长的因素也有望得到增强。尤其在实际应用中,推理过程涉及到对大量实时数据的快速处理和决策,仍然需要强大的算力支持。

在DeepSeek-V3刷屏之际,有一个bug也引发热议。

在试用DeepSeek-V3过程中,《每日经济新闻》记者在对话框中询问“你是什么模型”时,它给出了一个令人诧异的回答:“我是一个名为ChatGPT的AI语言模型,由OpenAl开发。”此外,它还补充说明,该模型是“基于GPT-4架构”。

国内外很多用户也都反映了这一现象。而且,12月27日,Sam Altman发了一个帖文,外媒指出,Altman这篇推文意在暗讽其竞争对手对OpenAI数据的挖掘。

于是,有人就开始质疑:DeepSeek-V3是否是在ChatGPT的输出基础上训练的?为此,《每日经济新闻》向深度求索发出采访请求。截至发稿,尚未收到回复。

针对这种情况产生的原因,每经记者采访了机器学习奠基人之一、美国人工智能促进会前主席Thomas G. Dietterich,他表示,他对全新的DeepSeek模型的细节还了解不够,无法给出确切的答案。“但从普遍情况来说,几乎所有的大模型都主要基于公开数据进行训练,因此没有特别需要合成的数据。这些模型都是通过仔细选择和清理训练数据(例如,专注于高质量来源的数据)来取得了改进。”

TechCrunch则猜测称,深度求索可能用了包含GPT-4通过ChatGPT生成的文本的公共数据集。“如果DeepSeek-V3是用这些数据进行训练的,那么该模型可能已经记住了GPT-4的一些输出,现在正在逐字反刍它们。”

“显然,该模型(DeepSeek-V3)可能在某些时候看到了ChatGPT的原始反应,但目前尚不清楚从哪里看到的,”伦敦国王学院专门研究人工智能的研究员Mike Cook也指出,“这也可能是个‘意外’。”他进一步解释称,根据竞争对手AI系统输出训练模型的做法可能对模型质量产生“非常糟糕”的影响,因为它可能导致幻觉和误导性答案。

不过,DeepSeek-V3也并非是第一个错误识别自己的模型,谷歌的Gemini等有时也会声称是竞争模型。例如,Gemini在普通话提示下称自己是百度的文心一言聊天机器人。

造成这种情况的原因可能在于,AI公司在互联网上获取大量训练数据,但是,现如今的互联网本就充斥着各种各样用AI生产出来的数据。据外媒估计,到2026年,90%的互联网数据将由AI生成。这种 “污染” 使得从训练数据集中彻底过滤AI输出变得相当困难。

“互联网数据现在充斥着AI输出,”非营利组织AI Now Institute的首席AI科学家Khlaaf表示,基于此,如果DeepSeek部分使用了OpenAI模型进行提炼数据,也不足为奇。

】【交错战线周年自选6⭐推荐******

交错战线周年自选6⭐推荐如下:

周年庆自选6⭐选取,首先就是,拿到先不要用,等抽完定制卡池再补缺。

纯辅助:

乌琳-打火再动加攻治疗

芭音-拉条打火加攻治疗

袅韵-治疗解控打火加攻

一般来说,袅韵适合中后期活动高难本,乌琳/芭音适合任何时间段。作者3个都80级了,目前满特性袅韵只在高难活动本上场,如果是反击队提尔锋时期入坑,还是先选袅韵比较好。

纯输出:

赤溟-半年限定

黑兔-核爆艺术

赤溟是半周年限定,强度也在线。如果有赤溟选项,闭着眼选赤溟,毕竟下次复刻不知道什么时候了。

黑兔乌斯怀亚是核爆队的核心,秒天秒地秒空气,有了黑兔,10回合?不!6回合干趴BOSS!尤其是这次白兔复刻来个黑白配,谁不迷糊。

阵容核心补缺:

卡提那-协击核心

提尔锋-反击核心

C.C.C.-虫洞核心

巴德-不朽减防

什么,你问我怎么用?全角色老登为啥要用,当然是拿来收藏了

最后统一回复一下即将入坑的萌新入坑时间:周年庆一定要入坑,最好自建号。赤溟肯定复刻,指不定自选里面就有。这游戏不缺抽卡券,自建号安全,搞个4万聚宝盆美滋滋,立省大几千。

】【福至天墉 《问道》8月万宝阁活动来袭******

福利风暴席卷中洲,元灵坐骑重磅来袭,《问道》8月万宝阁活动正在进行中!十阶坐骑、三天技元灵、神兽,还有精魄、秘籍、法宝等稀有道具大放送!各位道友们快来围观一下吧!

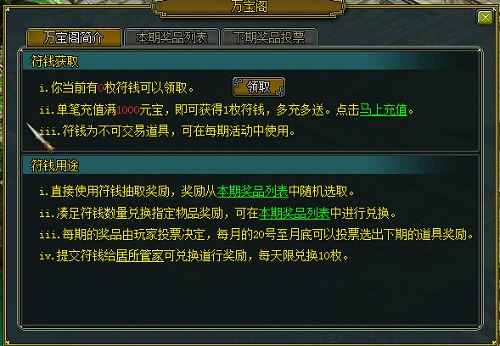

本次万宝阁活动将于8月1日开启至8月31日结束。玩家点击界面右上角的“万宝阁”小图标,即可参与活动。万宝阁活动中的符钱道具为指定货币,玩家每兑换1000元宝,即可获得一枚“符钱”道具。玩家可以用其在万宝阁活动中进行抽奖、兑换商城道具或者兑换数值,但是该道具不能作为交易货币直接使用。

本次万宝阁奖品分为九类,首先是稀有大奖,有十阶坐骑北斗天蓬,三天技元灵笛舞、三天技混沌,三天技神兽玄武、三天技疆良、三天技麒麟还有元灵、神兽、变异精魄以及特级道具等奖励。此类稀有大奖,只能使用“符钱”道具通过抽奖获得,不能使用符钱直接兑换。玩家可一次只使用一枚符钱,也可以一次使用十枚铜钱。每次抽取必定获得道具奖励。

然后是道具好礼,第一类道具好礼主要以秘籍为主,具有神龙罩、乾坤罩、如意圈、拔苗助长、翻转乾坤、天生神力等14本秘籍,以及一个“天行石”道具,玩家可以选择可以抽奖获取此类道具,获得试用160符钱直接进行兑换。第二类道具好礼,则是由打造装备必备的超级粉水晶,激活星图的各类石头,以及让我们能够幻化成Q版形象的幻形镜组成。

第三类道具好礼主要以法宝为主,如九火神龙印、番天印、金蛟剪、混元金斗等,大多需要27至40枚符钱就可以进行兑换,每项法宝都拥有一项特殊的技能,能够帮助各位道友增加战力,如番天印的功能就是有一定几率出现法术连击。连击的技能从不高于施法的技能阶次中随机选择一种技能。

除此之外,《问道》8月万宝阁活动,还有更多道具好礼等你来挖掘!另外,每个月20号至月末,在当月兑换元宝数量超过1000的玩家还可以对下一期的可兑换奖励进行投票,决定下一期中万宝阁中的道具类型,各位道友不要忘记哦!

】【中国联通运营公司原副总裁朱立军接受审查调查******

中央纪委国家监委网站12月27日通报,据中国联通纪检监察组、河南省纪委监委消息:中国联通运营公司原副总裁朱立军涉嫌严重违纪违法,目前正接受中国联通纪检监察组和河南省三门峡市监委纪律审查和监察调查。

】【刷屏的DeepSeek******

每经记者 郑雨航 每经编辑 高涵 兰素英

“DeepSeek-V3超越了迄今为止所有开源模型。”这是国外独立评测机构Artificial Analysis测试了DeepSeek-V3后得出的结论。

12月26日,深度求索官方微信公众号推文称,旗下全新系列模型DeepSeek-V3首个版本上线并同步开源。

公众号推文是这样描述的:DeepSeek-V3为自研MoE模型,671B参数,激活37B,在14.8T token上进行了预训练。DeepSeek-V3多项评测成绩超越了Qwen2.5-72B和Llama-3.1-405B等其他开源模型,并在性能上和世界顶尖的闭源模型GPT-4o以及Claude-3.5-Sonnet不分伯仲。

不过,广发证券发布的测试结果显示,DeepSeek-V3总体能力与其他大模型相当,但在逻辑推理和代码生成领域具有自身特点。

更重要的是,深度求索使用英伟达H800 GPU在短短两个月内就训练出了DeepSeek-V3,仅花费了约558万美元。其训练费用相比GPT-4等大模型要少得多,据外媒估计,Meta的大模型Llama-3.1的训练投资超过了5亿美元。

消息一出,引发了海外AI圈热议。OpenAI创始成员Karpathy甚至对此称赞道:“DeepSeek-V3让在有限算力预算上进行模型预训练这件事变得容易。DeepSeek-V3看起来比Llama-3-405B更强,训练消耗的算力却仅为后者的1/11。”

然而,在使用过程中,《每日经济新闻》记者发现,DeepSeek-V3竟然声称自己是ChatGPT。一时间,“DeepSeek-V3是否在使用ChatGPT输出内容进行训练”的质疑声四起。

对此,《每日经济新闻》记者采访了机器学习奠基人之一、美国人工智能促进会前主席Thomas G. Dietterich,他表示对全新的DeepSeek模型的细节还了解不够,无法给出确切的答案。“但从普遍情况来说,几乎所有的大模型都主要基于公开数据进行训练,因此没有特别需要合成的数据。这些模型都是通过仔细选择和清理训练数据(例如,专注于高质量来源的数据)来取得改进。”

每经记者向深度求索公司发出采访请求,截至发稿,尚未收到回复。

针对DeepSeek-V3,独立评测网站Artificial Anlaysis就关键指标——包括质量、价格、性能(每秒生成的Token数以及首个Token生成时间)、上下文窗口等多方面——与其他人工智能模型进行对比,最终得出以下结论。

质量:DeepSeek-V3质量高于平均水平,各项评估得出的质量指数为80。

价格:DeepSeek-V3比平均价格更便宜,每100万个Token的价格为0.48美元。其中,输入Token价格为每100万个Token 0.27美元,输出Token价格为每100万个Token1.10 美元。

速度:DeepSeek-V3比平均速度慢,其输出速度为每秒87.5个Token。

延迟:DeepSeek-V3与平均水平相比延迟更高,接收首个Token(即首字响应时间)需要1.14秒。

上下文窗口:DeepSeek-V3的上下文窗口比平均水平小,其上下文窗口为13万个Token。

最终Artificial Anlaysis得出结论:

“DeepSeek-V3模型超越了迄今为止发布的所有开放权重模型,并且击败了OpenAI的GPT-4o(8月),并接近Anthropic的Claude 3.5 Sonnet(10月)。

DeepSeek-V3的人工智能分析质量指数得分为80,领先于OpenAI的GPT-4o和Meta的Llama 3.3 70B等模型。目前唯一仍然领先于DeepSeek的模型是谷歌的Gemini 2.0 Flash和OpenAI的o1系列模型。领先于阿里巴巴的Qwen2.5 72B,DeepSeek现在是中国的AI领先者。”

12月29日广发证券计算机行业分析师发布研报称:“为了深入探索DeepSeek-V3的能力,我们采用了覆盖逻辑、数学、代码、文本等领域的多个问题对模型进行测试,将其生成结果与豆包、Kimi以及通义千问大模型生成的结果进行比较。”

测试结果显示,DeepSeek-V3总体能力与其他大模型相当,但在逻辑推理和代码生成领域具有自身特点。例如,在密文解码任务中,DeepSeek-V3是唯一给出正确答案的大模型;而在代码生成的任务中,DeepSeek-V3给出的代码注释、算法原理解释以及开发流程的指引是最为全面的。在文本生成和数学计算能力方面,DeepSeek-V3并未展现出明显优于其他大模型之处。

除了能力,DeepSeek-V3最让业内惊讶的是它的低价格和低成本。

《每日经济新闻》记者注意到,亚马逊Claude 3.5 Sonnet模型的API价格为每百万输入tokens 3美元、输出15美元。也就是说,即便是不按照优惠价格,DeepSeek-V3的使用费用也几乎是Claude 3.5 Sonnet的五十三分之一。

相对低廉的价格,得益于DeepSeek-V3的训练成本控制,深度求索在短短两个月内使用英伟达H800 GPU数据中心就训练出了DeepSeek-V3模型,花费了约558万美元。其训练费用相比OpenAI的GPT-4等目前全球主流的大模型要少得多,据外媒估计,Meta的大模型Llama-3.1的训练投资超过了5亿美元。

DeepSeek“AI界拼多多”也由此得名。

DeepSeek-V3通过数据与算法层面的优化,大幅提升算力利用效率,实现了协同效应。在大规模MoE模型的训练中,DeepSeek-V3采用了高效的负载均衡策略、FP8混合精度训练框架以及通信优化等一系列优化措施,显著降低了训练成本,以及通过优化MoE专家调度、引入冗余专家策略、以及通过长上下文蒸馏提升推理性能。这证明,模型效果不仅依赖于算力投入,即使在硬件资源有限的情况下,依托数据与算法层面的优化创新,仍然可以高效利用算力,实现较好的模型效果。

广发证券分析称,DeepSeek-V3算力成本降低的原因有两点。

第一,DeepSeek-V3采用的DeepSeekMoE是通过参考了各类训练方法后优化得到的,避开了行业内AI大模型训练过程中的各类问题。

第二,DeepSeek-V3采用的MLA架构可以降低推理过程中的kv缓存开销,其训练方法在特定方向的选择也使得其算力成本有所降低。

科技媒体Maginative的创始人兼主编Chris McKay对此评论称,对于人工智能行业来说,DeepSeek-V3代表了一种潜在的范式转变,即大型语言模型的开发方式。这一成就表明,通过巧妙的工程和高效的训练方法,可能无需以前认为必需的庞大计算资源,就能实现人工智能的前沿能力。

他还表示,DeepSeek-V3的成功可能会促使人们重新评估人工智能模型开发的既定方法。随着开源模型与闭源模型之间的差距不断缩小,公司可能需要在一个竞争日益激烈的市场中重新评估他们的策略和价值主张。

不过,广发证券分析师认为,算力依然是推动大模型发展的核心驱动力。DeepSeek-V3的技术路线得到充分验证后,有望驱动相关AI应用的快速发展,应用推理驱动算力需求增长的因素也有望得到增强。尤其在实际应用中,推理过程涉及到对大量实时数据的快速处理和决策,仍然需要强大的算力支持。

在DeepSeek-V3刷屏之际,有一个bug也引发热议。

在试用DeepSeek-V3过程中,《每日经济新闻》记者在对话框中询问“你是什么模型”时,它给出了一个令人诧异的回答:“我是一个名为ChatGPT的AI语言模型,由OpenAl开发。”此外,它还补充说明,该模型是“基于GPT-4架构”。

国内外很多用户也都反映了这一现象。而且,12月27日,Sam Altman发了一个帖文,外媒指出,Altman这篇推文意在暗讽其竞争对手对OpenAI数据的挖掘。

于是,有人就开始质疑:DeepSeek-V3是否是在ChatGPT的输出基础上训练的?为此,《每日经济新闻》向深度求索发出采访请求。截至发稿,尚未收到回复。

针对这种情况产生的原因,每经记者采访了机器学习奠基人之一、美国人工智能促进会前主席Thomas G. Dietterich,他表示,他对全新的DeepSeek模型的细节还了解不够,无法给出确切的答案。“但从普遍情况来说,几乎所有的大模型都主要基于公开数据进行训练,因此没有特别需要合成的数据。这些模型都是通过仔细选择和清理训练数据(例如,专注于高质量来源的数据)来取得了改进。”

TechCrunch则猜测称,深度求索可能用了包含GPT-4通过ChatGPT生成的文本的公共数据集。“如果DeepSeek-V3是用这些数据进行训练的,那么该模型可能已经记住了GPT-4的一些输出,现在正在逐字反刍它们。”

“显然,该模型(DeepSeek-V3)可能在某些时候看到了ChatGPT的原始反应,但目前尚不清楚从哪里看到的,”伦敦国王学院专门研究人工智能的研究员Mike Cook也指出,“这也可能是个‘意外’。”他进一步解释称,根据竞争对手AI系统输出训练模型的做法可能对模型质量产生“非常糟糕”的影响,因为它可能导致幻觉和误导性答案。

不过,DeepSeek-V3也并非是第一个错误识别自己的模型,谷歌的Gemini等有时也会声称是竞争模型。例如,Gemini在普通话提示下称自己是百度的文心一言聊天机器人。

造成这种情况的原因可能在于,AI公司在互联网上获取大量训练数据,但是,现如今的互联网本就充斥着各种各样用AI生产出来的数据。据外媒估计,到2026年,90%的互联网数据将由AI生成。这种 “污染” 使得从训练数据集中彻底过滤AI输出变得相当困难。

“互联网数据现在充斥着AI输出,”非营利组织AI Now Institute的首席AI科学家Khlaaf表示,基于此,如果DeepSeek部分使用了OpenAI模型进行提炼数据,也不足为奇。

】| 韩良俊 | 2025-01-07 |

| 沈王爷和天煞都非常努力,聪明上进,对事业有追求,怎么熊猫吃吃喝喝就把他们都打败了呢? | |

| 费宛筠 | 2025-01-07 |

| 超好看~~~~~~~~~~结尾我觉得可以更好看。123部片阿宝的性格应该用龙飞出去。飞回凡界。性格如此就应该炫耀一下吧。哈哈 | |

| 沐光霁 | 2025-01-07 |

| 奥尼查阿萨基:兄弟,你的手机是诺基亚 1000 不是你的错 | |

| 原贤 | 2025-01-07 |

| 家园 | |

| 长乐 | 2025-01-07 |

| 呜呜呜我好喜欢博斯啊😭😭他为“我”流泪了全结局达成但是cg标题还没有,不太想看广告了 | |

| 本琼芳 | 2025-01-07 |

| 去 | |

| 寒婷玉 | 2025-01-07 |

| 好游戏,不过这个厂商好像只是代理来着。 | |

| 蛮骏伟 | 2025-01-07 |

| 杰伦的曲风依然,我的口味却已经遂华语乐坛的浪潮渐渐改变。乍一听新歌,以为是十年前的老歌。除了回忆杀,对我而言,真的没有别的惊喜了。 | |

| 方高兴 | 2025-01-07 |

| 阿宝阿宝我一眼就看出来了🕔🕙🕞🕣🕐🕕🕚🕟🕤🕥🕠🕛🕖🕑🕒🕗🕜🕡🕦🕧🕢🕝🕘🕓 🇨🇳🇨🇳🇨🇳🇨🇳🇨🇳 | |

| 拱冷雁 | 2025-01-07 |

| 松松松松松 : 不用半年,3个月就能换一批人 | |